Baseado em artigo de Laura Ost - 24/09/2010

A diferença na passagem do tempo para objetos que se deslocam em velocidades diferentes é um dos aspectos mais discutidos e menos compreendidos da Teoria da Relatividade de Einstein.

Dadas as "dimensões sobre-humanas" envolvidas, envolvendo foguetes e gêmeos que viajam em naves espaciais, é difícil explicar o fenômeno e seus efeitos, e gerações de alunos de física têm saído da escola sem serem capazes de explicá-los de forma correta.

E isso apesar desses efeitos fazerem parte do nosso dia-a-dia. Por exemplo, a mudança na velocidade do tempo entre a superfície do planeta e o espaço exige correções constantes para os satélites artificiais da constelação GPS.

Relatividade do tempo

Agora, cientistas do laboratório NIST, nos Estados Unidos, conseguiram pela primeira vez medir o fenômeno em uma escala bem humana, de meros 33 centímetros, eventualmente abrindo caminho para que os estudantes finalmente possam compreendê-lo com mais facilidade.

Com isto, será possível, por exemplo, provar que alguém envelhece mais rapidamente se estiver alguns degraus mais alto na escada - ainda que o efeito seja pequeno demais para ser percebido diretamente por um ser humano.

Mesmo mudar-se para o alto de uma montanha não produziria efeito suficiente para aumentar a expectativa de vida de alguém de maneira significativa - na escala usada pelos cientistas, de 33 centímetros, o efeito da mudança na passagem do tempo acrescentaria cerca de 25 bilionésimos de segundo a alguém que vivesse 80 anos.

O experimento também permitiu que os pesquisadores checassem outro aspecto da relatividade - que o tempo passa mais lentamente quando você se move mais a uma velocidade maior.

Trazido às dimensões humanas, o aparato dispensou as naves espaciais e permitiu a verificação do efeito usando um carro rodando a uma velocidade de 32 quilômetros por hora.

Relógios lógicos quânticos

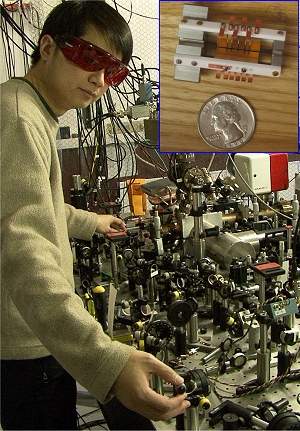

O detalhe mostra a "armadilha" onde fica aprisionado o íon de alumínio, enquanto James Chin-Wen Chou mostra o aparato necessário para que relógio atômico funcione. [Imagem: NIST]

Os cientistas observaram o fenômeno da dilatação do tempo previsto pela Teoria da Relatividade usando dois dos mais precisos relógios atômicos já construídos.

Os dois relógios são quase idênticos e dão seus "tiques" acompanhando as vibrações de um único íon de alumínio - um átomo de alumínio eletricamente carregado. O íon vibra entre dois estados de energia mais de um quatrilhão de vezes por segundo.

Com essa precisão, um dos relógios serve com base, mantendo a marcação do tempo com possibilidade de atrasar um segundo em cerca de 3,7 bilhões de anos. Ele é conectado ao outro por meio de um cabo de fibra óptica. Este segundo relógio é então movimentado para fazer os experimentos.

Esses relógios são também chamados de "relógios lógicos quânticos" porque usam técnicas de tomada de decisão lógica empregadas pelos experimentos de computação quântica. Eles são precisos e estáveis o suficiente para revelar diferenças na medição do tempo que não podiam ser monitoradas até agora.

Os relógios lógicos quânticos funcionam disparando a luz de um laser sobre o íon de alumínio em frequências ópticas, que são maiores do que as frequências de micro-ondas usadas atualmente nos relógios atômicos que estabelecem o padrão de tempo, baseados em átomos de césio.

Teoria da Relatividade em escala humana

Os experimentos focaram dois cenários previstos pela Teoria da Relatividade de Einstein.

No primeiro, quando dois relógios estão sujeitos a forças gravitacionais diferentes, por estarem em diferentes elevações acima da superfície da Terra, o relógio que estiver mais alto experimenta uma força gravitacional menor e, por isto, seus tiques ocorrem a uma velocidade ligeiramente maior - o que equivale a uma passagem mais rápida do tempo em relação ao relógio em posição inferior.

No segundo cenário, quando um observador está se movendo, o tique de um relógio estacionário parecerá durar mais do ponto de vista daquele observador, o que fará com que ele marque o tempo mais lentamente. Ou o oposto, o tique do relógio do observador baterá a uma velocidade ligeiramente menor, fazendo com que o tempo para ele passe mais lentamente em relação ao relógio fixo.

Os cientistas chamam isso de "paradoxo dos gêmeos", porque um gêmeo que viaje em uma nave espacial, ao voltar para casa, estará mais novo do que seu irmão. O fator crucial nesse fenômeno é a aceleração (o aumento e a redução na velocidade) que o gêmeo-astronauta experimenta em sua viagem.

Os cientistas observaram estes fenômenos fazendo alterações específicas em um dos dois relógios atômicos de alumínio e medindo as diferenças resultantes em relação ao outro relógio usado como parâmetro.

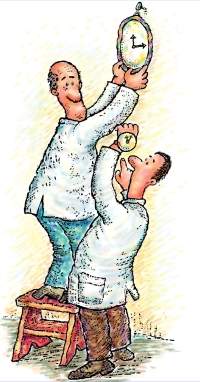

Os cientistas colocaram um dos relógios atômicos cerca de trinta centímetros mais alto do que o outro, o suficiente para comprovar os efeitos da teoria da relatividade. [Imagem: Loel Barr/NIST]

No primeiro experimento, os cientistas colocaram um dos relógios cerca de trinta centímetros mais alto do que o outro. As medições mostraram exatamente os resultados previstos pela teoria.

Como um relógio atômico é grande e sensível demais para ser colocado no porta-malas de um carro, para fazer o segundo experimento os cientistas fizeram o íon de alumínio - que fica praticamente parado no interior do relógio atômico - se movimentasse para frente para trás, resultando em velocidades equivalentes a um movimento de alguns metros por segundo. De novo, o resultado foi exatamente o previsto pela relatividade.

Relógios atômicos de alumínio

Essas comparações entre relógios superprecisos eventualmente poderão ser úteis em geodésia, a ciência que mede a Terra e seu campo gravitacional, com aplicações em hidrologia e geofísica e, eventualmente, em testes das teorias fundamentais da física usando observatórios espaciais.

Os relógios atômicos de alumínio conseguem detectar os pequenos efeitos da relatividade devido à sua extrema precisão e a um elevado fator "Q", uma quantidade que reflete de forma confiável como o íon absorve e retém a energia óptica ao passar de um nível de energia para outro.

"Nós observamos o maior fator Q já visto em física atômica", disse James Chin-Wen Chou, que coordenou os experimentos. "Você pode pensar nisso como o tempo que um diapasão vibra antes de perder a energia armazenada em sua estrutura ressonante. Nós colocamos o íon oscilando em sincronia com a frequência do laser por cerca de 400 trilhões de ciclos."

Os cientistas esperam que, no futuro, os relógios atômicos ópticos permitam a criação de padrões de medição do tempo 100 vezes mais precisos do que os atuais - veja também Batido recorde mundial do menor tempo já medido.

Bibliografia:

Optical Clocks and Relativity

C. W. Chou, D. B. Hume, T. Rosenband, D. J. Wineland

Science

24 September 2010

Vol.: 329 pp. 1630-1633

DOI: 10.1126/science.1192720

Fonte: Site Inovação Tecnológica- www.inovacaotecnologica.com.brURL: http://www.inovacaotecnologica.com.br/noticias/noticia.php?artigo=relogios-atomicos-teoria-relatividade-escala-humana